视频版ContorlNet来了!SparseCtrl增强AI生成视频可控性

11月30日 消息:在文本到视频(T2V)领域的最新研究中,SparseCtrl技术通过引入时间稀疏信号实现了对视频结构的灵活控制。传统的文本提示在空间不确定性方面存在问题,容易导致模糊的帧组合。

为了提高可控性,SparseCtrl采用了密集结构信号,如逐帧深度/边缘序列,但与此同时减轻了推断的负担。这项技术通过引入额外的条件编码器来处理这些稀疏信号,同时保持预训练的T2V模型不受影响。

项目地址:https://guoyww.github.io/projects/SparseCtrl/

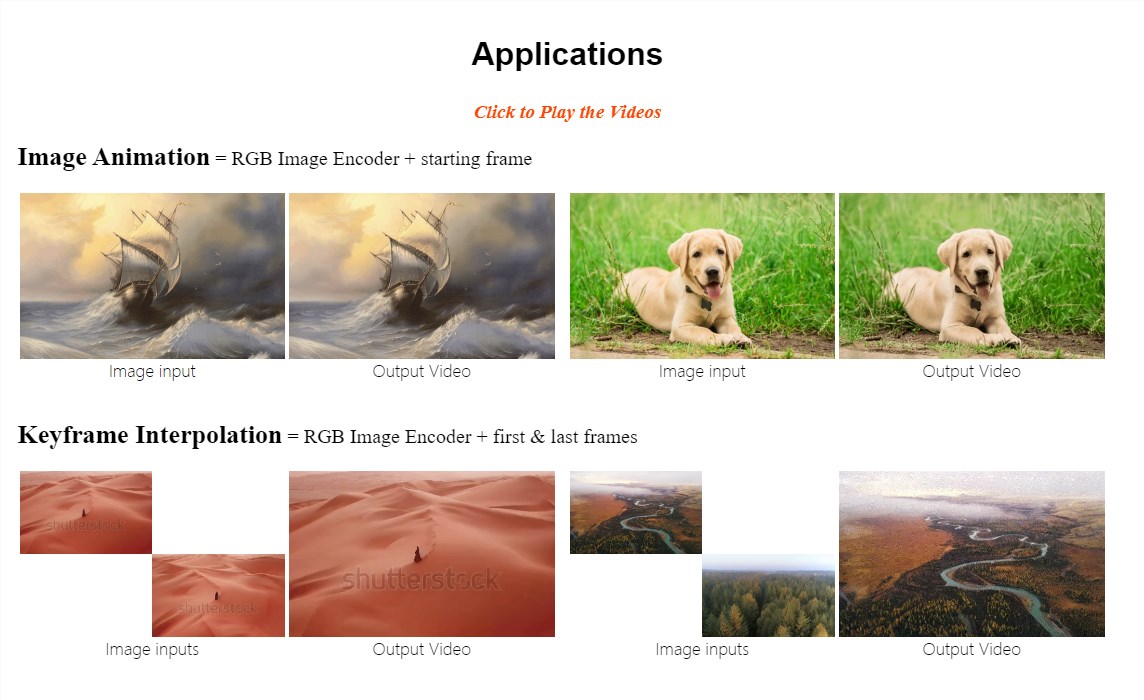

最令人振奋的是,SparseCtrl对各种输入形式具有兼容性,包括草图、深度和RGB图像,从而为视频生成提供了更为实际的控制方式。

这种方法的应用领域非常广泛,涵盖了多个方面。故事板制作、深度渲染、关键帧动画和插值都能从SparseCtrl中受益。通过大量实验证明了SparseCtrl在原始和个性化T2V生成器上的泛化能力。这标志着在T2V领域迈出了一大步,不仅提高了生成视频的质量,还为用户提供了更多实用的控制手段。这项研究展示了SparseCtrl的巨大潜力,有望在未来推动文本到视频技术的发展。

在技术原理方面,SparseCtrl通过引入额外的条件编码器,实现了对时间稀疏信号的高效处理,这使得模型能够更好地理解和利用这些信号,从而实现对视频生成过程的更灵活控制。

这种技术设计的巧妙之处在于,它不需要改变已有的T2V模型,而是通过增加一个组件来增强其功能。这样的设计不仅提高了可扩展性,还有助于更好地利用现有的模型和数据。

SparseCtrl的出现为文本到视频领域注入了新的活力。其灵活性、兼容性和泛化能力使其在实际应用中具有广阔的前景。未来,我们可以期待看到SparseCtrl在各种领域的广泛应用,为视频生成领域带来更多的创新和可能性。