RNN模型挑战Transformer统治地位 Eagle 7B模型登顶多语言基准测试(rnn lstm transformer)

来源:网络 浏览:27次 时间:2024-02-19

2月19日 消息:近年来,随着大模型的崛起,RNN模型Eagle7B挑战了Transformer的霸主地位。该模型在多语言基准测试中表现卓越,同时推理成本降低数十倍。不仅如此,Eagle7B采用了RNN架构,在英语测试中与其他顶尖模型不相上下。这一突破性的成就标志着RNN模型在人工智能领域的重要进展。

在团队的努力下,RWKV致力于打造包容性人工智能,支持全球排名前25种语言,覆盖40亿人口,而非仅仅局限于英语。团队希望通过降低模型成本、支持更多语言,让人工智能可以惠及更多人群。这种以人为本的理念,引领着人工智能技术的发展方向。

论文地址:https://arxiv.org/pdf/2305.13048.pdf

值得注意的是,在模型训练过程中发现,随着训练数据规模的增加,模型性能逐步提升。这一现象暗示着数据对模型性能提升的重要性,相比具体架构,数据的质量和规模可能对模型的表现影响更大。因此,未来的人工智能发展需要更高效、可扩展的架构,以降低成本、提高性能,并减少环境影响。

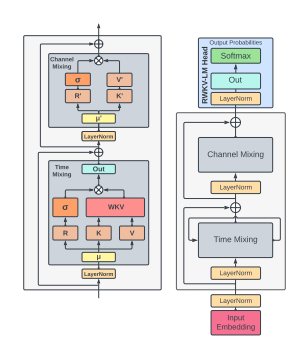

通过引入RNN和Transformer的优点,RWKV架构实现了GPT级别的LLM性能,同时保持了训练的并行化。该架构具有出色的性能、快速推理和训练速度,以及节省资源的优点,为人工智能技术的进步带来了新的可能性。通过不断探索和创新,人工智能技术将更好地为人类社会和个体提供服务。